前言

反爬虫是网站为了维护自己的核心安全而采取的抑制爬虫的手段,反爬虫的手段有很多种,一般情况下除了百度等网站,反扒机制会常常更新以外。为了保持网站运行的高效,网站采取的反扒机制并不是太多,今天分享几个我在爬虫过程中遇到的反扒机制,并简单介绍其解决方式。

基于User-Agent反爬

简介:服务器后台对访问的User_Agent进行统计,单位时间内同一User_Agent访问的次数超过特定的阀值,则会被不同程度的封禁IP,从而造成无法进行爬虫的状况。

解决方法:

一 . 将常见的User-Agent放到ua_list中,以列表形式进行随机使用

代码示例:

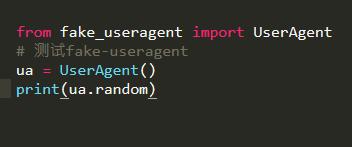

二. 加载fake_useragent库,随机生成User-Agent添加到headers中

代码示例:

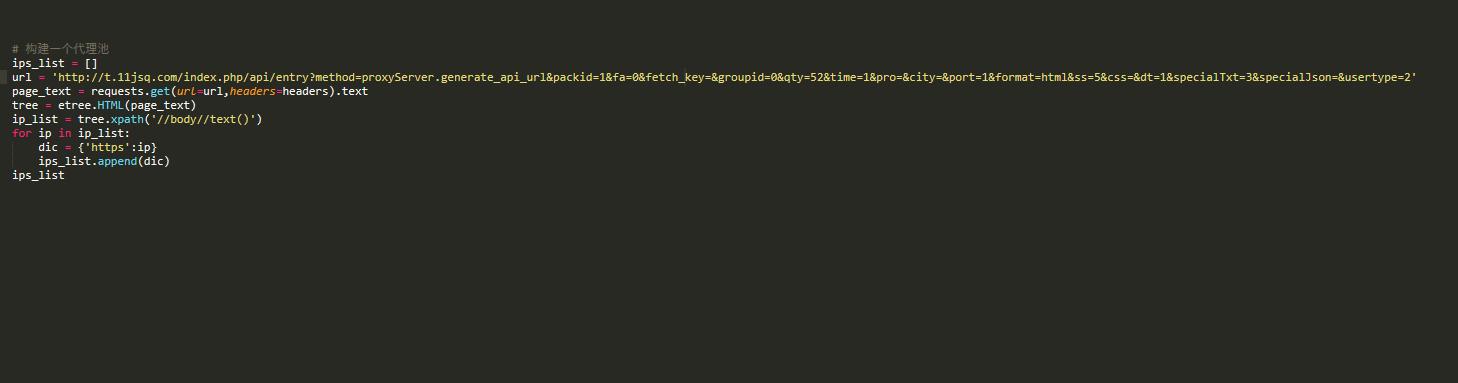

2 基于IP反爬

简介: 爬虫程序可能会在短时间内对指定的服务器发起高频的请求。后台服务器对访问进行统计,单位时间内同一IP访问的次数超过一个特定的值(阀值),就会不同程度的禁封IP,导致无法进行爬虫操作。

解决方法:使用代理池,并设定延迟访问

如何获取代理服务器?免费:西祠代理、快代理、goubanjia 收费:代理精灵等

代码示例:

3 基于cookie反扒

简介:网站会通过cookie跟踪你的访问过程,如果发现有爬虫行为会立刻中断你的访问,比如特别快的填写表单,或者短时间内浏览大量页面。而正确地处理cookie,又可以避免很多采集问题,建议在采集网站过程中,检查一下这些网站生成的cookie,然后想想哪一个是爬虫需要处理的。

解决方法:

一 手动处理

将cookie封装到headers字典中,将该字典作用到get/post方法的headers参数中

二 自动处理

需要两次处理。第一次是为了捕获和存储cookie到session对象中,第二次就是用携带cookie的session进行请求发送,这次请求发送就是携带cookie发起的请求。可以跟requests一样调用get/post进行请求的发送。在使用session进行请求发送的过程中,如果产生了cookie,则cookie会被自动存储session对象中

代码示例:

#基于session自动处理

cookiesess = requests.Session()

#该次请求只是为了捕获cookie存储到sess中

sess.get(url='https://xueqiu.com/',headers=headers)

url = 'https://xueqiu.com/v4/statuses/public_timeline_by_category.json?since_id=-1max_id=20367942count=15category=-1'

json_data = sess.get(url=url,headers=headers).json()json_data

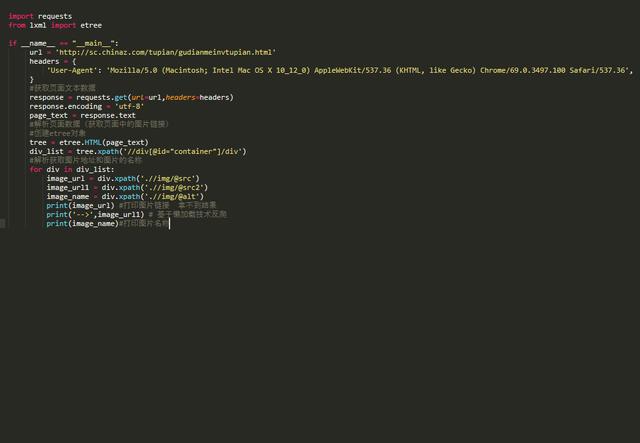

4 图片懒加载

简介:图片懒加载是一种网页优化技术。图片作为一种网络资源,在被请求时也与普通静态资源一样,将占用网络资源,而一次性将整个页面的所有图片加载完,将大大增加页面的首屏加载时间。为了解决这种问题,通过前后端配合,使图片仅在浏览器当前视窗内出现时才加载该图片,达到减少首屏图片请求数的技术就被称为“图片懒加载”。在网页源码中,在img标签中首先会使用一个“伪属性”(通常使用src2,original......)去存放真正的图片链接而并非是直接存放在src属性中。当图片出现到页面的可视化区域中,会动态将伪属性替换成src属性,完成图片的加载。

解决方法:通过细致观察页面的结构,发现图片的链接真正链的伪属性中,一般不在src中,而是src2中,xpath要使用该属性

示例代码:

5 Ajax动态加载

简介:从网页的 url 加载网页的源代码之后,会在浏览器里执行JavaScript程序。这些程序会加载出更多的内容,并把这些内容传输到网页中。这就是为什么有些网页直接爬它的URL时却没有数据的原因。现在这样的网站也越来越多。

解决方法:使用审查元素分析”请求“对应的链接(方法:右键→审查元素→Network→清空,点击”加载更多“,出现对应的GET链接寻找Type为text/html的,点击,查看get参数或者复制Request URL),循环过程。如果“请求”之前有页面,依据上一步的网址进行分析推导第1页。以此类推,抓取抓Ajax地址的数据。对返回的json使用requests中的json进行解析,观察动态加载的规律,在请求头中对规律进行使用

抓包工具推荐:fiddler

到此这篇关于python反扒机制的5种解决方法的文章就介绍到这了,更多相关python反扒机制内容请搜索脚本之家以前的文章或继续浏览下面的相关文章希望大家以后多多支持脚本之家!

您可能感兴趣的文章:- Python爬虫实例扒取2345天气预报

- python解决网站的反爬虫策略总结

- python爬虫的一个常见简单js反爬详解

- 详解python 破解网站反爬虫的两种简单方法

- python通过伪装头部数据抵抗反爬虫的实例

- Python反爬虫伪装浏览器进行爬虫

- Python常见反爬虫机制解决方案

- python 常见的反爬虫策略

- python中绕过反爬虫的方法总结

咨 询 客 服

咨 询 客 服