环境说明:

操作系统: centos7 64位 3台

centos7-1 192.168.190.130 master

centos7-2 192.168.190.129 slave1

centos7-3 192.168.190.131 slave2

安装spark需要同时安装如下内容:

jdk scale

1.安装jdk,配置jdk环境变量

这里不讲如何安装配置jdk,自行百度。

2.安装scala

下载scala安装包,https://www.scala-lang.org/download/选择符合要求的版本进行下载,使用客户端工具上传到服务器上。解压:

#tar -zxvf scala-2.13.0-M4.tgz

再次修改/etc/profile文件,添加如下内容:

export SCALA_HOME=$WORK_SPACE/scala-2.13.0-M4

export PATH=$PATH:$SCALA_HOME/bin

#source /etc/profile // 让其立即生效

#scala -version //查看scala是否安装完成

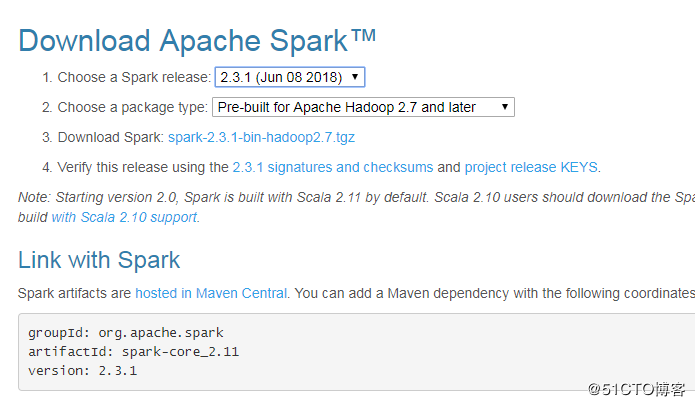

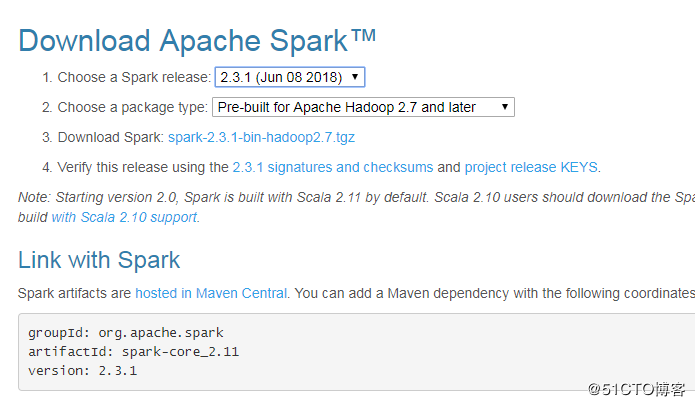

3.安装spark

spark下载地址:http://spark.apache.org/downloads.html

说明:有不同的版本包下载,选则你需要的下载安装即可

Source code: Spark 源码,需要编译才能使用,另外 Scala 2.11 需要使用源码编译才可使用

Pre-build with user-provided Hadoop: “Hadoop free” 版,可应用到任意 Hadoop 版本

Pre-build for Hadoop 2.7 and later: 基于 Hadoop 2.7 的预先编译版,需要与本机安装的 Hadoop 版本对应。可选的还有 Hadoop 2.6。我这里因为装的hadoop是3.1.0,所以直接安装for hadoop 2.7 and later的版本。

注:hadoop的安装请查看我的上一篇博客,不在重复描述。

centOS7下Spark安装配置

#mkdir spark

#cd /usr/spark

#tar -zxvf spark-2.3.1-bin-hadoop2.7.tgz

#vim /etc/profile

#添加spark的环境变量,加如PATH下、export出来

#source /etc/profile

#进入conf目录下,把spark-env.sh.template拷贝一份改名spark-env.sh

#cd /usr/spark/spark-2.3.1-bin-hadoop2.7/conf

#cp spark-env.sh.template spark-env.sh

#vim spark-env.sh

export SCALA_HOME=/usr/scala/scala-2.13.0-M4

export JAVA_HOME=/usr/lib/jvm/jre-1.8.0-openjdk-1.8.0.171-8.b10.el7_5.x86_64

export HADOOP_HOME=/usr/hadoop/hadoop-3.1.0

export HADOOP_CONF_DIR=$HADOOP_HOME/etc/hadoop

export SPARK_HOME=/usr/spark/spark-2.3.1-bin-hadoop2.7

export SPARK_MASTER_IP=master

export SPARK_EXECUTOR_MEMORY=1G

#进入conf目录下,把slaves.template拷贝一份改名为slaves

#cd /usr/spark/spark-2.3.1-bin-hadoop2.7/conf

#cp slaves.template slaves

#vim slaves

#添加节点域名到slaves文件中

#master //该域名为centos7-1的域名

#slave1 //该域名为centos7-2的域名

#slave2 //该域名为centos7-3的域名

启动spark

#启动spark之前先要把hadoop节点启动起来

#cd /usr/hadoop/hadoop-3.1.0/

#sbin/start-all.sh

#jps //检查启动的线程是否已经把hadoop启动起来了

#cd /usr/spark/spark-2.3.1-bin-hadoop2.7

#sbin/start-all.sh

备注:在slave1\slave2节点上也必须按照上面的方式安装spark,或者直接拷贝一份到slave1,slave2节点上

#scp -r /usr/spark root@slave1ip:/usr/spark

启动信息如下:

starting org.apache.spark.deploy.master.Master, logging to /usr/spark/logs/spark-root-org.apache.spark.deploy.master.Master-1-master.out

slave2: starting org.apache.spark.deploy.worker.Worker, logging to /usr/spark/logs/spark-root-org.apache.spark.deploy.worker.Worker-1-slave2.com.cn.out

slave1: starting org.apache.spark.deploy.worker.Worker, logging to /usr/spark/logs/spark-root-org.apache.spark.deploy.worker.Worker-1-slave1.com.cn.out

master: starting org.apache.spark.deploy.worker.Worker, logging to /usr/spark/logs/spark-root-org.apache.spark.deploy.worker.Worker-1-master.out

测试Spark集群:

用浏览器打开master节点上的spark集群url:http://192.168.190.130:8080/

总结

以上所述是小编给大家介绍的centOS7下Spark安装配置教程详解,希望对大家有所帮助,如果大家有任何疑问欢迎给我留言,小编会及时回复大家的!

咨 询 客 服

咨 询 客 服